Các lỗi sai thường gặp khi phân tích dữ liệu bằng SPSS và cách khắc phục

Trong quá trình phân tích dữ liệu bằng SPSS, rất nhiều sinh viên và học viên dù thực hiện đúng thao tác phần mềm nhưng kết quả thu được vẫn bị đánh giá là sai phương pháp, thiếu logic hoặc không đạt yêu cầu học thuật. Nguyên nhân chủ yếu không nằm ở SPSS mà xuất phát từ những lỗi sai phổ biến trong từng bước xử lý dữ liệu.

Bài viết này tổng hợp các lỗi sai thường gặp khi phân tích dữ liệu bằng SPSS, đi theo đúng quy trình nghiên cứu định lượng, đồng thời hướng dẫn cách khắc phục cụ thể để giúp bạn tránh sai sót, nâng cao chất lượng luận văn và nghiên cứu khoa học.

1. Phân tích dữ liệu bằng SPSS là gì?

Phân tích dữ liệu bằng SPSS là quá trình sử dụng phần mềm SPSS để xử lý, kiểm tra và rút ra kết luận từ bộ dữ liệu khảo sát. Quá trình này bao gồm nhiều bước như làm sạch dữ liệu, kiểm định độ tin cậy thang đo, phân tích nhân tố, hồi quy và kiểm định giả thuyết.

Mục tiêu cuối cùng không chỉ là chạy ra bảng kết quả mà còn phải hiểu đúng ý nghĩa thống kê và diễn giải sao cho phù hợp với mục tiêu nghiên cứu. Nếu một bước trong chuỗi này bị làm sai, toàn bộ kết quả phía sau đều mất giá trị.

2. Khi nào cần đặc biệt chú ý đến lỗi sai trong SPSS?

Việc kiểm soát lỗi khi phân tích SPSS đặc biệt quan trọng khi bạn đang làm luận văn tốt nghiệp, luận án, đề tài nghiên cứu khoa học hoặc báo cáo học thuật. Những nghiên cứu sử dụng thang đo Likert, phân tích EFA, Cronbach’s Alpha hay hồi quy tuyến tính rất dễ gặp lỗi nếu không nắm chắc nguyên tắc. Ngược lại, với các bài tập nhỏ hoặc phân tích mô tả đơn giản, mức độ rủi ro thấp hơn nhưng vẫn cần kiểm tra kỹ dữ liệu đầu vào.

3. Quy trình phân tích dữ liệu SPSS đúng chuẩn để tránh lỗi

Một quy trình xử lý dữ liệu SPSS đầy đủ thường gồm 8 giai đoạn chính:

- Chuẩn bị dữ liệu và mã hóa dữ liệu.

- Khai báo biến .

- Thống kê mô tả và biểu đồ .

- Thống kê trung bình thang đo .

- Kiểm định độ tin cậy thang đo (Cronbach’s Alpha) .

- Phân tích EFA.

- Kiểm định tương quan Pearson.

- Phân tích hồi quy tuyến tính .

- Kiểm định T/test / ANOVA

4. Các lỗi sai thường gặp khi phân tích dữ liệu bằng SPSS

Khi sử dụng SPSS để làm luận văn hoặc nghiên cứu khoa học, nhiều sinh viên thường mắc lỗi không phải vì SPSS quá khó, mà vì chưa hiểu rõ ý nghĩa từng bước. Những lỗi dưới đây là các sai sót phổ biến nhất, được giải thích đơn giản để bạn có thể tránh ngay từ lần đầu phân tích.

4.1 Nhập dữ liệu sai hoặc nhập không đồng nhất

Lỗi này thường xảy ra khi nhập dữ liệu thủ công nhưng không kiểm tra lại sau khi nhập.

Ví dụ, cùng một câu hỏi khảo sát nhưng:

-

Có người nhập thang đo 1–5

-

Có người lại nhập 0–4

-

Hoặc một số ô bị bỏ trống / nhập nhầm số

Khi đó, SPSS sẽ hiểu các giá trị này là những nhóm khác nhau, dẫn đến:

-

Kết quả thống kê bị sai lệch

-

Phân tích sau (Cronbach’s Alpha, EFA, hồi quy…) không chính xác

Cách khắc phục: Sau khi nhập dữ liệu, hãy chạy thống kê tần số (Frequencies) để xem có giá trị lạ hay không. Nếu thấy số ngoài thang đo, cần sửa lại ngay.

.jpg)

Kết quả thống kê tần số cho thấy biến giới tính xuất hiện một số giá trị không hợp lệ như 0, 6, 7.

Trong khi đó, biến giới tính chỉ được mã hóa theo thang đo danh nghĩa:

-

1 = Nam

-

2 = Nữ

Do đó, các giá trị 0, 6, 7 được xác định là lỗi nhập liệu.

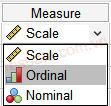

4.2 Khai báo sai loại biến (Nominal – Ordinal – Scale)

Rất nhiều sinh viên khai báo biến đo bằng thang Likert (1–5) là Nominal, trong khi đáng ra phải là Scale.

-> SPSS sẽ không cho bạn chạy Cronbach’s Alpha, EFA hoặc hồi quy nếu biến không đúng loại.

Cách chọn loại biến:

-

Câu hỏi chọn giới tính → Nominal

-

Câu hỏi mức độ đồng ý (Likert) → Scale

-

Câu hỏi có thứ tự nhưng không đo lường chính xác khoảng cách → Ordinal

4.3 Chạy Cronbach’s Alpha nhưng không biết loại biến

Nhiều bạn thấy Cronbach’s Alpha > 0.7 là giữ tất cả biến, nhưng không kiểm tra cột Corrected Item–Total Correlation.

-> Có biến làm giảm độ tin cậy của thang đo nhưng vẫn bị giữ lại.

.jpg)

.jpg)

Dựa trên kết quả kiểm định độ tin cậy thang đo:

-

Cronbach’s Alpha = 0.793 > 0.6

→ Thang đo đạt độ tin cậy, có thể sử dụng trong phân tích tiếp theo. -

Biến ĐC3 có Corrected Item–Total Correlation = 0.200 < 0.3

→ Biến ĐC3 không tương quan tốt với thang đo, làm giảm chất lượng thang đo. -

Cronbach’s Alpha if Item Deleted (loại ĐC3) = 0.860 > 0.793

→ Khi loại biến ĐC3, độ tin cậy của thang đo tăng lên, chứng tỏ ĐC3 là biến không phù hợp.

Quy tắc áp dụng:

-

Biến nào có Corrected Item–Total Correlation < 0.3 → loại

-

Thang đo có Cronbach’s Alpha ≥ 0.6 → được chấp nhận

4.4 Phân tích EFA khi dữ liệu chưa đủ điều kiện

Rất nhiều sinh viên thực hiện phân tích nhân tố khám phá (EFA) theo hướng dẫn có sẵn nhưng bỏ qua bước kiểm tra điều kiện dữ liệu, cụ thể là chỉ số KMO và Rotated Matrix.

Nếu dữ liệu không đạt điều kiện, thì:

-

Kết quả EFA không có ý nghĩa khoa học

-

Các nhân tố rút trích không đáng tin cậy

-

Dẫn đến sai sót ở các bước phân tích tiếp theo

.jpg)

Kết quả kiểm tra chỉ số KMO cho thấy:

-

KMO = 0.757

-

Giá trị này nằm trong khoảng 0.5 < KMO < 1

-

Giá trị Sig. (cột cuối cùng) < 0.001

Theo phân loại của Kaiser (1974), mức KMO trong khoảng này được đánh giá là tốt, cho thấy:

-

Mức độ tương quan giữa các biến là phù hợp

-

Dữ liệu đủ điều kiện để tiến hành phân tích nhân tố

.jpg)

Kết quả phân tích nhân tố cho thấy các biến quan sát được nhóm thành 6 nhân tố riêng biệt, phù hợp với mô hình nghiên cứu ban đầu. Các hệ số tải nhân tố đều lớn hơn 0,6, đáp ứng tiêu chuẩn và không có biến nào bị loại khỏi mô hình.

Cụ thể, nhóm biến DU gồm DU1 đến DU5 có hệ số tải dao động từ 0,712 đến 0,806, cho thấy các biến này đại diện tốt cho cùng một nhân tố. Nhóm biến NL (NL1–NL5) có hệ số tải từ 0,777 đến 0,834, thể hiện mức độ hội tụ cao.

Nhóm biến DC (DC1–DC5) đạt hệ số tải từ 0,756 đến 0,851, phản ánh sự gắn kết chặt chẽ giữa các biến quan sát. Bên cạnh đó, các biến TC (TC1–TC4) được rút trích thành một nhân tố với hệ số tải từ 0,681 đến 0,828. Nhóm biến HH (HH1–HH3) có hệ số tải từ 0,763 đến 0,874, và nhóm biến GC (GC1–GC3) đạt hệ số tải từ 0,761 đến 0,826.

Nhìn chung, kết quả EFA khẳng định các thang đo trong nghiên cứu có cấu trúc rõ ràng, giá trị hội tụ tốt và phù hợp để sử dụng trong các phân tích tiếp theo như phân tích tương quan và hồi quy tuyến tính.

Tiêu chuẩn đánh giá EFA:

-

KMO ≥ 0.5 → được phân tích EFA

-

Sig. Bartlett’s Test < 0.05 → dữ liệu phù hợp

-

Factor Loading ≥ 0.5 → biến đạt yêu cầu

4.5 Hiểu nhầm tương quan là nguyên nhân – kết quả

Một lỗi rất phổ biến khi phân tích dữ liệu bằng SPSS là chỉ dựa vào hệ số tương quan Pearson và thấy Sig. < 0.05 thì vội kết luận rằng “X ảnh hưởng đến Y”.

-> Cách hiểu này là sai.

Phân tích tương quan chỉ cho biết mức độ liên hệ giữa hai biến, không chứng minh mối quan hệ nguyên nhân – kết quả.

.jpg)

Kết quả phân tích tương quan Pearson cho thấy các biến độc lập trong mô hình đều có mối tương quan tuyến tính dương và có ý nghĩa thống kê với biến phụ thuộc HL (Sig. < 0,001). Trong đó, TC có mức tương quan mạnh nhất với HL (r = 0,577), tiếp theo là NL (r = 0,451). Các biến DU, HH, DC và GC có mức tương quan dương trung bình với HL.

Bên cạnh đó, hệ số tương quan giữa các biến độc lập đều nhỏ hơn 0,8, cho thấy không xảy ra hiện tượng đa cộng tuyến nghiêm trọng. Do đó, dữ liệu đáp ứng điều kiện để tiếp tục thực hiện phân tích hồi quy tuyến tính.

Kết luận:

-

Tương quan → chỉ nói có mối liên hệ

-

Hồi quy → mới kết luận ảnh hưởng

4.6 Chạy hồi quy nhưng không kiểm tra điều kiện

Một lỗi rất thường gặp khi phân tích hồi quy tuyến tính trong SPSS là chỉ tập trung đọc hệ số Beta để kết luận mức độ ảnh hưởng, trong khi bỏ qua các chỉ số kiểm tra điều kiện của mô hình.

Điều này rất nguy hiểm, vì mô hình hồi quy có thể vi phạm các giả định thống kê, khiến kết luận đưa ra không còn giá trị khoa học, dù hệ số Beta có đẹp đến đâu.

Phân tích hồi quy tuyến tính chỉ có ý nghĩa khi:

-

Các biến độc lập không tương quan quá mạnh với nhau

-

Phần dư không có hiện tượng tự tương quan

-

Mô hình tổng thể phù hợp với dữ liệu nghiên cứu

Nếu bỏ qua các bước này, kết quả hồi quy có thể bị sai lệch, dẫn đến việc diễn giải và kết luận sai trong luận văn.

Các chỉ số bắt buộc phải kiểm tra khi chạy hồi quy trong SPSS:

a. VIF < 5

- Không xảy ra hiện tượng đa cộng tuyến nghiêm trọng

- Các biến độc lập đủ độc lập để đưa vào mô hình hồi quy

Nếu VIF quá lớn, hệ số Beta không còn đáng tin cậy.

.jpg)

b. Durbin–Watson nằm trong khoảng từ 1.5 đến 2.5

- Phần dư không có hiện tượng tự tương quan

- Mô hình hồi quy đạt giả định độc lập của sai số

Chỉ số này đặc biệt quan trọng với dữ liệu khảo sát theo chuỗi hoặc mẫu lớn.

.jpg)

c. Sig. của kiểm định ANOVA < 0.05

- Mô hình hồi quy phù hợp với dữ liệu

- Ít nhất một biến độc lập có ảnh hưởng đến biến phụ thuộc

Nếu Sig. ANOVA ≥ 0.05, mô hình không đủ cơ sở để diễn giải kết quả.

.jpg)

5. Kết luận

Phân tích dữ liệu bằng SPSS là bước then chốt quyết định chất lượng của một nghiên cứu định lượng hay luận văn tốt nghiệp. Tuy nhiên, trên thực tế, rất nhiều sinh viên và người mới làm nghiên cứu thường mắc phải những lỗi cơ bản nhưng nghiêm trọng như nhập liệu không nhất quán, khai báo sai loại biến, bỏ qua kiểm định độ tin cậy thang đo, thực hiện EFA khi dữ liệu chưa đủ điều kiện, hiểu sai kết quả tương quan Pearson hoặc chạy hồi quy nhưng không kiểm tra các giả định của mô hình.

Điểm chung của các lỗi này là làm sai quy trình nhưng vẫn cố diễn giải kết quả, dẫn đến kết luận thiếu cơ sở khoa học và dễ bị giảng viên hoặc hội đồng phản biện đánh giá thấp. Trong nhiều trường hợp, chỉ một lỗi nhỏ ở bước đầu cũng có thể khiến toàn bộ kết quả phân tích SPSS không còn giá trị sử dụng.

Vì vậy, thay vì chỉ học cách “bấm SPSS”, người nghiên cứu cần hiểu rõ bản chất từng bước phân tích, kiểm tra đầy đủ các điều kiện cần thiết trước khi kết luận và luôn đối chiếu kết quả với nguyên tắc thống kê cơ bản. Việc nhận diện sớm các lỗi sai thường gặp sẽ giúp tiết kiệm thời gian, tránh phải làm lại đề tài và nâng cao tính học thuật cho bài nghiên cứu.

Tóm lại, làm đúng SPSS không nằm ở việc chạy được bao nhiêu lệnh, mà nằm ở việc hiểu mình đang làm gì, kết quả nói lên điều gì và được phép kết luận đến đâu.

6. Câu hỏi thường gặp khi phân tích dữ liệu bằng SPSS

Vì sao sinh viên thường phân tích SPSS bị sai?

Sinh viên thường phân tích SPSS bị sai do chưa hiểu rõ thang đo, nhập dữ liệu không đúng chuẩn, lựa chọn sai kiểm định thống kê hoặc diễn giải nhầm ý nghĩa các chỉ số trong bảng kết quả.

Những lỗi phổ biến nhất khi xử lý dữ liệu SPSS là gì?

Các lỗi phổ biến khi xử lý dữ liệu SPSS bao gồm: mã hóa biến sai, không kiểm tra dữ liệu thiếu, sử dụng sai kiểm định thống kê và chỉ đọc kết quả mà không kiểm tra điều kiện của mô hình.

Sai thang đo có ảnh hưởng đến kết quả phân tích SPSS không?

Sai thang đo ảnh hưởng rất lớn đến kết quả phân tích SPSS vì mỗi phương pháp thống kê chỉ phù hợp với một loại thang đo nhất định. Nếu chọn sai, kết quả nghiên cứu có thể không còn giá trị.

Làm thế nào để biết kết quả SPSS có đáng tin cậy không?

Để đánh giá kết quả SPSS có đáng tin cậy hay không, cần kiểm tra lại dữ liệu đầu vào, xem xét điều kiện áp dụng của các kiểm định và đối chiếu kết quả với cơ sở lý thuyết nghiên cứu.